机器人技术的迭代正以指数级速度重塑人类社会的基本结构。从工业流水线上精准作业的机械臂,到家庭场景中承担照料功能的服务机器人,再到科研领域参与复杂实验的智能设备,这些由代码与金属构成的存在已渗透进生产生活的核心领域。技术突破带来的不仅是效率提升,更引发了关于生命本质、意识定义与伦理责任的深层思考。当机器人能够模拟人类情感表达,甚至在特定领域展现出超越人类的决策能力时,传统伦理体系面临着前所未有的挑战。如何在技术进步与伦理底线之间建立平衡,成为每个文明发展阶段都必须回应的命题。

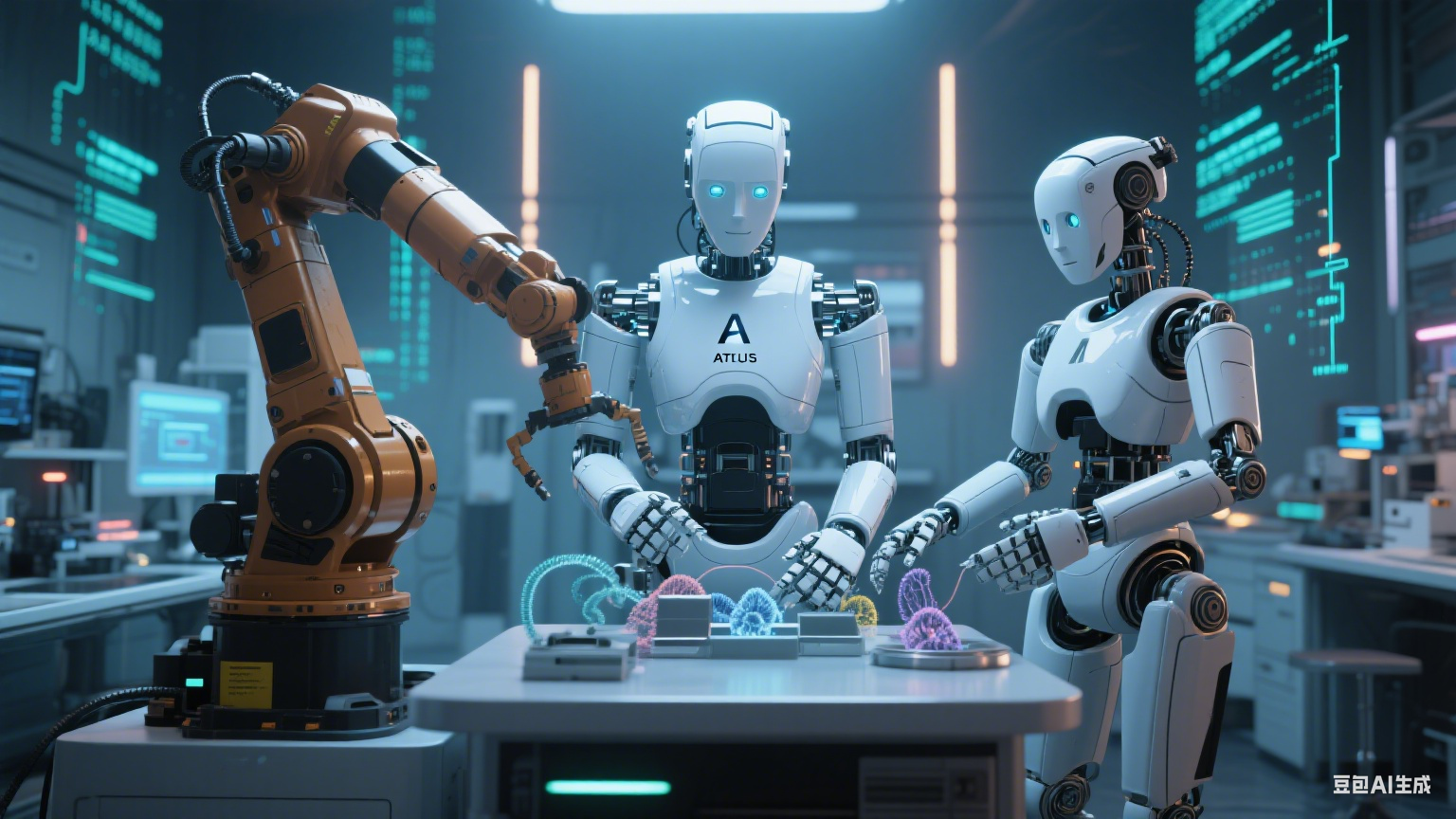

现代机器人技术的演进始终围绕 “类人化” 与 “功能化” 两个核心方向展开。早期工业机器人以单一功能为导向,通过预设程序完成重复性劳动,其本质是人类肢体的延伸与强化。随着传感器技术、机器学习算法与算力的突破,机器人开始具备环境感知、自主决策与自适应学习能力。波士顿动力公司研发的 Atlas 机器人能够完成跑跳、后空翻等复杂动作,其运动控制精度已接近人类生理极限;DeepMind 团队打造的 AlphaFold 则通过深度学习破解了蛋白质折叠难题,为生物医学研究提供了革命性工具。这些技术成就背后,是千万行代码构建的逻辑体系,也是人类对自身能力的镜像式探索。

机器人的智能属性始终处于 “模拟” 与 “自主” 的模糊地带。当前主流人工智能技术基于深度学习模型,通过对海量数据的训练形成决策模式,这种 “智能” 本质上是对人类思维过程的算法化复刻,缺乏自我意识与主观能动性。2016 年 AlphaGo 战胜李世石的比赛中,机器人的每一步决策都源于对历史棋局数据的概率计算,而非对围棋艺术的理解与感悟。但随着生成式 AI 技术的发展,机器人已能创作出符合人类审美标准的文学作品、绘画与音乐,这种 “创造性” 引发了关于知识产权归属与创作本质的争议 —— 当机器生成的诗歌获得文学奖项时,荣誉应当归于开发者、机器人本身,还是数据提供者?

技术普及带来的社会结构变革正在悄然发生。制造业中,机器人的大规模应用使全球产业分工重新洗牌,低技能岗位数量持续萎缩,而高端技术人才需求激增,这种结构性失业问题在发展中国家尤为突出。日本作为老龄化严重的国家,已在养老领域部署超过 10 万台护理机器人,这些设备能够协助老人完成起居、康复训练等活动,一定程度上缓解了劳动力短缺压力,但也引发了 “情感替代” 的担忧 —— 机器的精准照料能否弥补人类关怀的温度?在医疗领域,手术机器人凭借微米级的操作精度提升了手术成功率,但当手术出现意外时,责任认定成为难题:是开发者的算法缺陷、医院的操作失误,还是机器人的 “自主决策” 导致了事故?

伦理规范的滞后性成为制约技术发展的关键瓶颈。目前全球尚未形成统一的机器人伦理准则,各国的监管政策存在显著差异:欧盟 2021 年出台的《人工智能法案》将机器人分为不同风险等级实施分类监管,而美国则采取行业自律为主的监管模式。这种监管差异导致跨国企业面临合规难题,也为技术滥用留下了空间。更严峻的是,军用机器人技术的发展已触及 “致命自主武器系统” 的伦理红线,这类机器人能够在无人类干预的情况下识别并攻击目标,其存在可能引发新的军备竞赛,甚至改变战争的本质。如何通过国际公约限制致命性自主武器的研发与使用,成为维护全球安全的重要议题。

机器人技术的发展还催生了新的哲学命题。传统哲学认为意识是人类大脑的专属产物,依赖于神经细胞的复杂连接与生物化学反应,但机器人的 “类意识” 表现正在挑战这一认知。哲学家大卫・查尔莫斯提出的 “硬问题”—— 意识如何从物理系统中产生 —— 在人工智能时代有了新的内涵:如果未来机器人能够通过图灵测试,甚至表达出 “自我认知”,我们是否应当赋予其道德主体地位?一些学者认为,当机器人具备感受痛苦与快乐的能力时,就应当享有基本的道德权利,如不被随意销毁的权利;而反对者则坚持,机器的 “情感表达” 只是算法模拟,缺乏生物基础的意识不能等同于人类意识。这种争论不仅关乎技术发展方向,更触及了人类对自身存在本质的认知。

技术发展的终极方向应当是实现人机协同的和谐共生。机器人不是取代人类的竞争对手,而是拓展人类能力边界的工具。在航天领域,机器人已成为人类探索宇宙的先锋 —— 祝融号火星车在火星表面的探测活动,将人类的认知范围延伸到地外星球;在深海科考中,水下机器人能够潜入万米深渊,探索地球最深处的奥秘。这些案例证明,机器人能够承担人类无法完成的任务,成为人类认知世界的 “延伸器官”。未来的发展方向不应是追求机器人的 “全面类人化”,而是构建人机互补的生态系统:人类专注于创造性思维、情感交流与价值判断,机器人则承担重复性、高风险、高精度的工作,形成 “人类智慧 + 机器能力” 的协同模式。

教育体系的改革是适应人机协同时代的基础。传统教育模式注重知识的传授与记忆,而未来社会更需要具备批判性思维、创造力与情感智慧的人才 —— 这些正是当前机器人技术难以替代的核心能力。各国应当调整教育目标,加强 STEAM 教育(科学、技术、工程、艺术、数学)的普及,培养学生的跨学科思维与创新能力;同时注重人文素养的培育,使未来的技术开发者既懂算法逻辑,又明伦理底线。企业则需要承担起职业培训的责任,帮助被技术替代的劳动者实现技能转型,避免技术进步加剧社会分化。

全球协作是应对机器人技术挑战的必然选择。技术的无国界性决定了伦理问题的全球性,任何国家都无法独自应对机器人技术带来的风险。国际社会应当建立常态化的对话机制,推动机器人伦理准则的全球共识,特别是在数据隐私保护、算法透明度、自主武器限制等关键领域形成统一标准。发展中国家应积极参与全球技术治理,避免因技术鸿沟导致新的 “数字殖民”—— 发达国家有责任向发展中国家转移适宜技术,帮助其建立符合自身国情的监管体系。只有通过全球范围内的合作与共治,才能确保机器人技术沿着造福人类的方向发展。

从工业革命时期的蒸汽机到信息时代的计算机,每一次技术革命都伴随着争议与挑战,机器人技术的发展也不例外。技术本身并无善恶之分,其影响取决于人类如何运用。当我们惊叹于机器人的精准与高效时,不应忽视背后的伦理风险;当我们担忧技术替代带来的冲击时,更应看到人机协同创造的新可能。未来,机器人是否会产生真正的意识?人机边界是否会逐渐模糊?这些问题或许没有标准答案,但可以确定的是,人类对技术的理性反思与伦理坚守,将决定机器人技术最终走向何方。在这场技术与伦理的博弈中,人类的选择不仅关乎自身的未来,更定义着文明的高度。

免责声明:文章内容来自互联网,本站仅作为分享,不对其真实性负责,如有侵权等情况,请与本站联系删除。

转载请注明出处:机器意识的边界:人工智能时代的伦理诘问 https://www.dachanpin.com/a/tg/54321.html