2020年,闹得大家人心惶惶的新冠肺炎疫情,竟然早有一家创业公司通过AI 监测平台预测到了。也许就有人好奇了,它是如何预测的,背后的技术又可以如何深入运用?本文将给你带来一些思考与启发。

预测未知,一直是人类十分向往的能力。

远不说国人熟悉的周易八卦、唐代道士编写的《推背图》,还有西方人熟知的占星术、中世纪流行起来的塔罗牌。

近的比如说当年根据 “2012世界末日”这一玛雅预言影响下出现的全民狂热和商业狂欢,依然让我们记忆犹新。

现在“不问苍生问鬼神”的时代已经过去,我们对物理世界及社会经济的确定性的、经验性的甚至概率性的预测都已轻车熟路。但比如说像“蝴蝶效应”描述的高度复杂的、超多变量以及超大数据量的预测,人类还是束手无策么?

答案并不是。

近日,我国武汉新型冠状病毒疫情的爆发引起世界卫生组织和全球多地卫生机构的密切关注。其中,《连线》杂志报道了“一家加拿大公司BlueDot通过AI监测平台率先预测和发布武汉出现传染疫情”的新闻,得到国内媒体的广泛关注。

这似乎是我们在“预测未来”这件事上最想看到的成果——借助大数据沉淀基础和AI的推断,人类似乎正能够揣摩“天意”,揭示出原本深藏于混沌之中的因果规律,从而在天灾降临前试图挽救世界。

今天我们就从传染病预测出发,看看AI是如何一步步走向“神机妙算”的。

一、谷歌GFT频喊“狼来了”:流感大数据的狂想曲用AI预测传染病显然不是Bluedot的专利,其实早在2008年,今天的AI“强手”谷歌,就曾进行过一次不太成功的尝试。

2008年谷歌推出一个预测流感流行趋势的系统——Google Flu Trends(谷歌流感趋势,以下简称GFT)。

GFT一战成名是在2009年美国H1N1爆发的几周前,谷歌工程师在《Nature》杂志上发表了一篇论文,通过谷歌累积的海量搜索数据,成功预测H1N1在全美范围的传播。

就流感的趋势和地区分析中,谷歌用几十亿条检索记录,处理了4.5亿个不同的数字模型,构造出一个流感预测指数,其结果与美国疾病控制和预防中心(CDC)官方数据的相关性高达97%,但要比CDC提前了整整2周。

在疫情面前,时间就是生命,速度就是财富,如果GFT能一直保持这种“预知”能力,显然可以为整个社会提前控制传染病疫情赢得先机。然而,预言神话没有持续多久。2014年,GFT又再次受到媒体关注,但这一次却是因为它糟糕的表现。

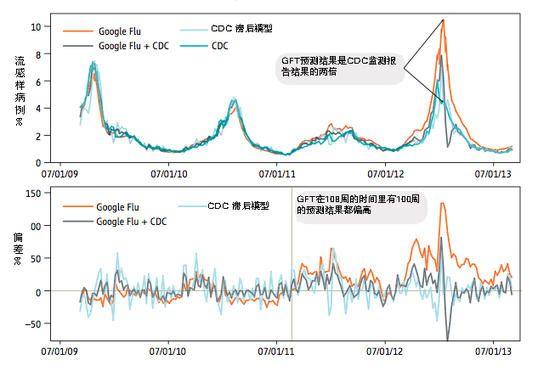

研究人员2014年又在《Science》杂志发布 “谷歌流感的寓言:大数据分析的陷阱” 一文,指出在2009年,GFT没有能预测到非季节性流感A-H1N1。从2011年8月到2013年8月的108周里,GFT有100周高过了CDC报告的流感发病率。高估了多少呢?

在2011-2012季,GFT预测的发病率是CDC报告值的1.5倍多;而到2012-2013季,GFT预测流感发病率已是CDC报告值的2倍多。

(图表来自The Parable of Google Flu: Traps in Big Data Analysis | Science,2014)尽管GFT在2013年调整了算法,并回应称出现偏差的罪魁祸首是媒体对GFT的大幅报道导致人们的搜索行为发生了变化,GFT预测的2013-2014季的流感发病率,仍然高于CDC报告值1.3倍。并且研究人员前面发现的系统性误差仍然存在,也就是“狼来了”的错误仍然在犯。

到底GFT遗漏了哪些因素,让这个预测系统陷入窘境?

根据研究人员分析,GFT的大数据分析出现如此大的系统性误差,其收集特征和评估方法可能存在以下问题:

1. 大数据傲慢(Big Data Hubris)所谓“大数据傲慢”,就是谷歌工程师给出的前提假设就是,通过用户搜索关键词得到的大数据包含的即是流感疾病的全数据收集,可以完全取代传统数据收集(采样统计),而不是其补充。也就是GFT认为“采集到的用户搜索信息”数据与 “某流感疫情涉及的人群”这个总体完全相关。

这一 “自大”的前提假设忽视了数据量巨大并不代表数据的全面和准确,因而出现在2009年成功预测的数据库样本不能涵盖在之后几年出现的新的数据特征。

也是因为这份“自负”,GFT也似乎没有考虑引入专业的健康医疗数据以及专家经验,同时也并未对用户搜索数据进行“清洗”和“去噪”,从而导致此后流行病发病率估值过高但又无力解决的问题。

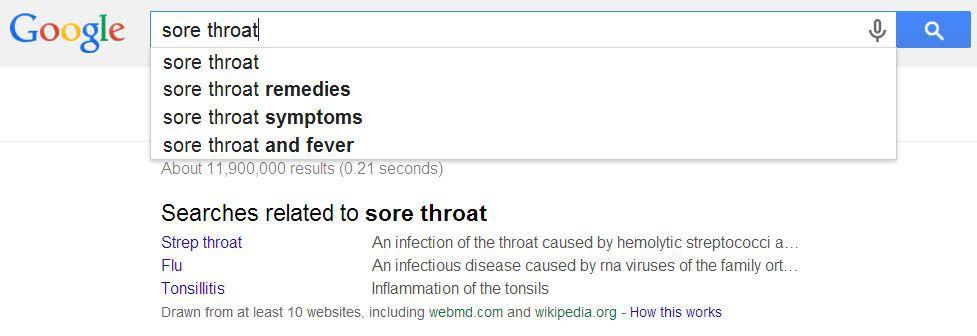

2. 搜索引擎演化同时搜索引擎的模式也并非一成不变的,谷歌在2011年之后推出“推荐相关搜索词”,也就是我们今天很熟悉的搜索关联词模式。

比如针对流感搜索词,给出相关寻求流感治疗的list,2012年后还提供相关诊断术语的推荐。研究人员分析,这些调整有可能人为推高了一些搜索,并导致谷歌对流行发病率的高估。

举例来说,当用户搜索“喉咙痛”,谷歌会在推荐关键词给出“喉咙痛和发烧”、“如何治疗喉咙痛”等推荐,这时用户可能会出于好奇等原因进行点击,造成用户使用的关键词并非用户本意的现象,从而影响GFT搜集数据的准确性。

而用户的搜索行为反过来也会影响GFT的预测结果,比如媒体对于流感流行的报道会增加与流感相关的词汇的搜索次数,进而影响GFT的预测。

这就像量子力学家海森堡指出的,在量子力学中存在的“测不准原理”说明的一样,“测量即干涉”,那么,在充斥媒体报道和用户主观信息的搜索引擎的喧嚣世界里,也同样存在“预测即干涉”悖论。搜索引擎用户的行为并不完全是自发产生,媒体报道、社交媒体热点、搜索引擎推荐甚至大数据推荐都在影响用户心智,造成用户特定搜索数据的集中爆发。为什么GFT的预测总是偏高?

根据这一理论,我们可以知道,一旦GFT发布的流行病预测指数升高,立刻会引发媒体报道,从而导致更多相关信息搜索,从而又强化GFT的疫情判断,无论如何调整算法,也改变不了“测不准”的结果。

3. 相关而非因果研究人员指出,GFT的根源问题在于,谷歌工程师并不清楚搜索关键词和流感传播之间到底有什么因果联系,而只是关注数据之间的——统计学相关性特征。

过度推崇“相关”而忽略“因果”就会导致数据失准的情况。比如,以“流感”为例,如果一段时间该词搜索量暴涨,可能是因为推出一部《流感》的电影或歌曲,并不一定意味着流感真的在爆发。

(责任编辑:admin)免责声明:文章内容来自互联网,本站仅作为分享,不对其真实性负责,如有侵权等情况,请与本站联系删除。

转载请注明出处:AI 预测武汉疫情,创业公司如何攻占AI流行病预测? https://www.dachanpin.com/a/cyfx/10377.html